Model Collapse

L’invasion silencieuse du contenu IA

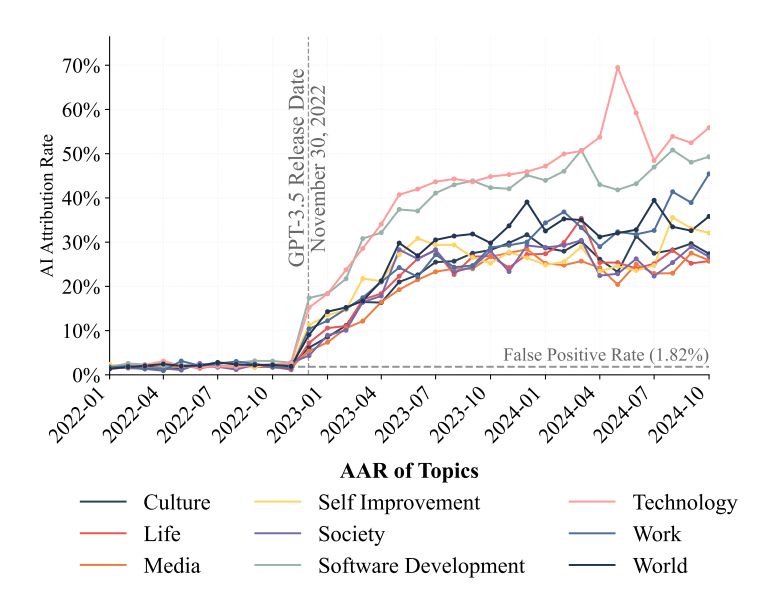

Une grande partie du contenu sur Internet est en train de devenir du contenu généré par IA. L’intégration progressive des LLMs (Large Language Models) dans notre quotidien démocratise et facilite leur utilisation. Les réseaux sociaux sont devenus de véritables mines d’or pour ce type de contenu : de plus en plus d’utilisateurs confient la rédaction ou la reformulation de leurs posts à ChatGPT ou LeChat de Mistral avant de les publier (peut-être que ce post y est passé aussi ? 👀). Un exemple frappant est celui de Quora dont le contenu généré par IA est passé de 2% en 2022 à ~38% en 2024 !

Un risque systémique : le Model Collapse 💥

Le problème, c’est qu’Internet constitue aussi, indirectement, la base des datasets sur lesquels ces modèles sont entraînés. Or, un modèle qui s'entraîne uniquement sur des données dites "synthétiques" perd progressivement des informations sur les éléments les moins fréquents, ses réponses deviennent plus génériques, et les biais existants s'accentuent. Le modèle s’effondre, on parle de Model Collapse💥.

Et demain ?

Aujourd’hui, aucun modèle n’est entraîné exclusivement sur des données synthétiques. Mais si la tendance actuelle se poursuit, les datasets d'entraînement continueront de croître et intégreront une part toujours plus importante de contenu généré par IA. Il sera alors crucial de porter une attention particulière à leur élaboration et à l’identification des contenus synthétiques, sous peine d’empoisonner nos futurs modèles.

📚 Sources

- Forbes - Is AI quietly killing itself – and the Internet? (2024)

- Are We in the AI-Generated Text World Already? Quantifying and Monitoring AIGT on Social Media — Zhen Sun

- AI World Today — AI-Generated Content Surges on Social Media: New Study Reveals Startling Trends (2024)

- AI models collapse when trained on recursively generated data — Ilia Shumailov (2024)

- Position: Will we run out of data? Limits of LLM scaling based on human-generated data — P Villalobos (2024)